Specjaliści Tencent Keen Security Lab przedstawili zakrojone na szeroką skalę badanie dotyczące włamywania się do samochodów Tesla. Podkreślić należy, że eksperci Tencent już nie pierwszy raz lokalizują i wykorzystują luki w zabezpieczeniach w Tesli.

Dla przykładu, chińscy eksperci jeszcze w 2016 roku zademonstrowali zdalne włamanie się do modelu Tesla Model S P85 oraz Model 75D, a rok później skompromitowali Tesla Model X poprzez przejęcie kontroli nad reflektorami, deską rozdzielczą, otwarcie drzwi i bagażnika oraz kontrolowaniem hamulców podczas jazdy. Dalsze testy Tesli również nie prezentują się zbyt optymistycznie dla marki.

Przechytrzenie samochodów Tesli

Tym razem badacze na przykładzie samochodów Tesla Model S 75 naocznie zademonstrowali, dlaczego niebezpieczne jest bezgraniczne poleganie na systemie wspomagania układu kierowniczego (to samo dotyczy ACC lub Enhanced Autopilot).

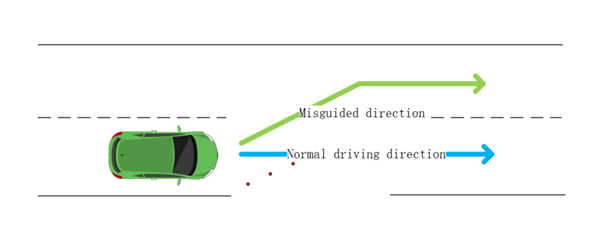

Okazało się, że wystarczyło umieścić na nawierzchni drogi pozornie niezauważalne dla kierowcy drobne przeszkody, aby auto „potraktowało” je jako poziome oznakowanie na drodze i, aby nie przekroczyć tej nieistniejącej linii, zmieniło pas ruchu (nawet na przeciwległy). Ta poważna wpadka Tesli z działaniem autopilota stanowi realne zagrożenie życia dla jej kierowców, którzy za bardzo zaufali tej funkcji.

Aby w pełni zrozumieć, w jaki sposób działa technologia wykrywania pasów ruchu przy włączonym Autosteer, badacze wykorzystali hardware w wersji 2.5 i oprogramowanie 2018.6.1. Funkcją, która ich szczególnie zainteresowała, była detect_and_track, która przekazuje liczne dane do procesorów. To, w jaki sposób „myśli” Tesla, pokazane zostało na ilustracji poniżej. Bazując na tej informacji pojazd tworzy wirtualną mapę, która wykorzystywana jest również do stworzenia mapy w rozdzielczości HD w czasie rzeczywistym, na której bazują pozostałe komponenty auta.

Wpadka zdalnie sterowanych samochodów Tesli

W konsekwencji specjaliści w dalszych testach Tesli zdecydowali się zaatakować system wizyjny pojazdu oraz neurosieciowe algorytmy Tesla poprzez wykorzystanie dawno omawianego zagadnienia adversarial examples. Mowa o sytuacjach, gdy do sieci neuronowych celowo dostarczane są zniekształcone dane, co prowadzi do pojawiania się problemów z prawidłowym rozpoznawaniem obiektów.

Oczywistym jest, że eksperci Tencent nie ograniczyli się wyłącznie do wirtualnych działań, а zdecydowali się na rzeczywiste umieszczenie na nawierzchni drogi naklejek tak niewielkich, że człowiek ledwie zwróciłby na nie uwagę. Okazało się to wystarczające do wprowadzenia auta w błąd. W filmie poniżej można zauważyć, jak gwałtownie samochody Tesla zmieniają pasy ruchu, sugerując się fałszywym oznakowaniem umieszczonym przez ekspertów.

Przypomnę, że podobne testy Tesli, tylko związane z „zamazaniem” znaków drogowych pionowych, a nie poziomych, zostało opublikowane jeszcze w 2017 roku przez grupę uczonych z uniwersytetów w USA. Również wtedy eksperci doszli do wniosku, że auta bezzałogowe, drony i inne tego typu urządzenia można w bardzo łatwy sposób „zbić z kursu”.

Oprócz tego raport badaczy Tencent szczegółowo opisuje dwie luki w zabezpieczeniach, które umożliwiają root-access do Autopilota ECU (APE) – obecnie już usunięte wraz z wersją 2018.24. Przez wpadkę Tesli badacze byli w stanie przejąć kontrolę nad kierownicą i sterować nią przy użyciu standardowego pada do konsoli do gier, podłączonego do smartfona przez Bluetooth.

Musk wdzięczny za testy Tesli

Specjaliści byli również w stanie opracować sposób na uruchomienie wycieraczek nawet w bezdeszczowy dzień. W tym celu przed autem umieszczono monitor ze specjalnie przygotowaną ilustracją, gdyż w tym przypadku auto „polega” na swoich sensorach optycznych. W związku z tym zmodyfikowany obrazek (który również stanowił adversarial example) był w stanie oszukać system w aucie.

Przedstawiciele Tesla zorientowali się, że trik z fałyszymi znakami drogowymi może stanowić dla ludzi realne zagrożenie życia – przecież kierowca pojazdu powinien zawsze być przygotowany na przejęcie sterowania od autopilota lub wciśnięcie pedału hamulca. Tę poważną wpadkę Tesli Elon Musk za pośrednictwem Twittera podziękował ekspertom za wkład w wykonaną pracę nad testami Tesli.

Jeśli podobało ci się, to polub nasz profil na LinkedIn żeby nie przegapić kolejnej publikacji. A w międzyczasie możesz poczytać o dziurach w bezpieczeństwie oraz metodach przejęcia samochodu w naszym następnym artykule.